Transformation digitale

AI ACT : prêt pour la révolution IA responsable ?

AI ACT législation inédite pour réguler l'IA sur un modèle responsable, éthique et sécurisé. Alexandre Rispal analyse ce nouveau cadre juridique.

Microsoft & ITESOFT : votre finance optimisée – ISAGRI témoigne

ITESOFT a le plaisir d’être partenaire de la première édition de la Althéa Padel Cup 🎾à Paris

🤖🎨 RSE, IA & art live : une inauguration haute en couleurs dans nos nouveaux locaux !

🎉 Fiers d’avoir signé la Charte pour la Diversité Numérique ! L’humain au cœur du digital

ITESOFT démarre l’aventure Bleu, le cloud souverain 100 % français avec Microsoft

Sommaire

Intelligence artificielle, AI, GAI, ASI, singularité, bots, Deep Learning, Machine Learning : si vous n’avez jamais entendu ces mots, c’est sans doute que Elon Musk vous a envoyé sur Mars en reconnaissance pour y trouver un endroit agréable pour sa retraite.

Vous vous demandez peut-être, surtout si votre métier est plus ou moins en rapport avec l’informatique, ce que se cache derrière toute cette terminologie. D’autant qu’elle s’accompagne de prédictions vigoureusement assénées, réparties entre craintes millénaristes (dans peu de temps une intelligence artificielle dirigera le monde et nous envisagera avec autant d’empathie que nous traitons un moustique) et promesses d’harmonie et d’abondance (et de vie !) éternelle. Chez ITESOFT nous pratiquons (modestement) l’intelligence artificielle depuis quelques décennies : ce type d’ algorithmes est à la base de la reconnaissance automatique de caractères et le classement de documents. Ceci nous donne un certain recul sur les prédictions mais aussi une vision des possibilités à venir.

L’intelligence Artificielle est un champ de l’informatique comportant une multitude d’interactions avec d’autres disciplines : la biologie (comprendre pour simuler le fonctionnement du cerveau pourrait être une stratégie viable pour faire « penser » une machine), la philosophie (qu’est-ce que la conscience ?) voire le droit (si une voiture conduite par un programme d’IA écrase un piéton, qui est responsable ?).

La particularité de l’Intelligence Artificielle, par rapport à d’autres technologies innovantes et disruptives, est d’être une prodigieuse machine à fantasmes, miroir de notre propre existence et nos craintes. Un cinéphile posera comme acte fondateur 2001 l’Odyssée de l’espace, avec l’ordinateur HAL 9000 qui tue une partie de l’équipage et finira rageusement « déprogrammé » en chantant une comptine enfantine. Après, il y eut Terminator, alimentant les craintes d’une intelligence supérieure à la nôtre qui aurait ses propres objectifs. Une version particulière des attaques d’extra-terrestres, à la nuance près que c’est notre propre création.

La thématique de la créature qui dépasse son créateur est vieille comme le monde : que ce soit dans les textes grecs ( Pygmalion), religieux ( le Golem) ou artistiques ( Frankenstein). Le désir d’accéder à la connaissance n’est- il pas le péché originel ?

L’intelligence Artificielle, après un engouement fort à ses débuts (années 50), est restée « au frigo » pendant quelques décennies, entre autre à cause de prévisions trop optimistes de ses fondateurs : ordinateur champion aux échecs en 1968 (1958 - Herbert Simon) ou capable de faire toutes les « tâches d’un humain moyen » en 1980 (1967 – Marvin Minsky).

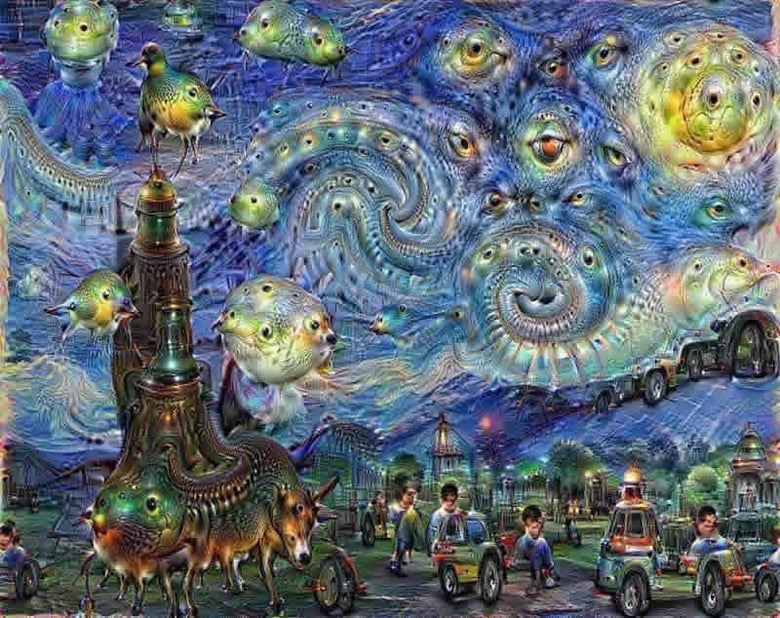

Et aussi de difficultés conceptuelles imprévues, et de manque de puissance des machines. Des progrès visibles apparaissent enfin : reconnaissance des lettres, des sons et des images (OCR, Reconnaissance vocale), victoire aux échecs (IBM Deep Blue contre Kasparov, 1997), à « questions pour un champion » (IBM Watson dans Jeopardy, 2011) et très récemment au jeu de go (Google DeepMind contre Lee Se-Dol, 2016). Voire production d’œuvres d’art, comme celle-ci dessous, vendue 8000 USD dans une vente aux enchères en Mars 2016.

Ils sont accompagnés de messages contradictoires, où le marketing le dispute à la technologie, dont il faudrait être un vrai spécialiste pour comprendre de qui se passe réellement. Optimistes : tous les trans-humanistes, dont le plus médiatique est Ray Kurzweil, l’inventeur génial de l’ OCR et de la reconnaissance vocale, actuellement patron de la R&D de Google (quel hasard) et futur immortel autoproclamé. Alarmistes : Bill Joy (confondateur de Sun dès 2000, dans un papier publié dans WIRED), et plus récemment Bill Gates, Steven Hawkins et Elon Musk, pour ne citer que les plus connus. Si ces brillants cerveaux naturels s’inquiètent de l’Intelligence Artificielle, il y a sans doute une bonne raison !

Il n’est pas possible de toutes les énumérer ici, et en plus les algorithmes et applications sont souvent « hybridées » avec d’autres technologies (notamment le Big Data). Nous allons quand même essayer ! Le champ le plus utilisé actuellement est l’ ANI ( Artificial Narrow Intelligence), aussi appelée Weak AI . Elle permet de traiter des tâches précises avec efficacité, mais est inopérante en dehors de son « champ d’expérience ». Quand vous parlez à Siri ou Cortana, vous utilisez une ANI.

Ces systèmes sont capables d’apprentissage plus ou moins autonome, mais en restant dans un cadre conceptuel précis, étroit. On parle de plus en plus du Machine Learning et du Deep Learning termes mis à la mode par Google. Le Machine Learning est l’application de méthodes statistiques à de très gros volumes de données pour en extraire des corrélations (donc du sens) en utilisant notamment des réseaux de neurones, type d’algorithme qui est inspiré du fonctionnement du cerveau. ITESOFT utilise par exemple des réseaux de neurones (autrement appelés perceptrons) pour reconnaître la facture de tel ou tel fournisseur.

Le Deep Learning est une version plus sophistiquée qui permet l’ auto apprentissage, alors que le Machine Learning nécessite un «coach» humain. Une méthode n’est pas meilleure que l’autre, cela dépend du problème qu’on cherche à résoudre. Un apprentissage, comme pour un humain, peut se faire en utilisant diverses stratégies : Généralisation : à partir d’exemples « vrais », déduire une règle.

Dans tous les cas, les fonctions de base à traiter sont comparables à celles d’un cerveau humain : classer, trier, comparer, simplifier, modéliser. Afin de résoudre des problèmes et de faire des prévisions.

Evidemment, le Graal (et la menace), c’est la simulation de la conscience. Autrement dit AGI ( Artificial General Intelligence) ou Strong AI qui pourrait devenir une ASI ( Artificial Super Intelligence) et tous nous transformer en trombones sans nous demander notre avis !

L’argument sous-jacent à l’ASI est la célèbre Loi de Moore et son corollaire la LOAR (Law of Accelerating Returns) , qui font que votre iPhone est aussi puissant qu’un super ordinateur des années 80 et coûte beaucoup moins cher. Application pratique : si demain un programme est aussi intelligent qu’un humain, après-demain il sera beaucoup, beaucoup plus intelligent, et donc totalement imprévisible. Le comportement d’un humain est-il prévisible pour le ver c.elegans qui possède 302 neurones ? Pas vraiment ! CQFD. L’AGI bute toutefois sur quelques difficultés conceptuelles majeures :

IBM, Google, Microsoft, Apple, mais aussi Facebook (avec son centre de R&D basé à Paris et dirigé par Yann Le Cun) investissent des dizaines de milliards dans le domaine. Le bouillonnement des startups est considérable et les applications innombrables : santé, défense, finance, entre autres. Il y a une « fertilisation croisée » entre l’IA et d’autres domaines, informatiques (Big Data, Cloud, …) ou scientifique (génomique, neurosciences).

Il est évident que l’accélération des progrès va continuer à transformer notre quotidien, à la maison et au bureau, et l’organisation sociale en générale, et qu’il est important d’y réfléchir et de nous y préparer. Est-ce pour autant que le prochain président des USA pourrait être Watson, comme le proposait un bloggueur humoristique ? Ray Kurtzweil va il gagner son pari de devenir immortel par silicone interposé ? Les paris sont ouverts ! La conférence de Stéphane Mallard lors de notre journée client vous a permis d’alimenter votre propre réflexion sur le sujet ! En savoir plus sur les technologies d'ITESOFT

Responsable communication et éditorial

Laurent rejoint ITESOFT en 2000. Directeur de Projet Marketing et diplômé de l’IAE d’Aix en Provence, il dispose d’une expérience de plus de 15 ans dans la production d’évènements, d’études et de contenus autour de la dématérialisation et de l’automatisation des processus.

Transformation digitale

AI ACT : prêt pour la révolution IA responsable ?

AI ACT législation inédite pour réguler l'IA sur un modèle responsable, éthique et sécurisé. Alexandre Rispal analyse ce nouveau cadre juridique.

Automatisation

ITESOFT fait progresser l’automatisation des processus d’entreprise

Découvrez les dernières innovations d'ITESOFT pour rendre les processus métier plus rapides, plus intelligents et plus sûrs.

Transformation digitale

Etude CXP en France : l'Enterprise Content Management

Le CXP a mené une étude auprès de plus 150 entreprises pour mesurer leur maturité sur l'Enterprise Content Management. Découvrez vite les résultats !

Découvrez nos ressources au sujet de : transformation digitale